Un exhaustivo estudio que explora la probabilidad de que Rusia despliegue robots autónomos en conflictos futuros, analizando la postura de Vladimir Putin y la comparativa con estrategias militares estadounidenses.

Exploración de la postura de Putin sobre IA y armamento autónomo

El reciente pronunciamiento del presidente ruso, Vladimir Putin, sugiere una postura ambivalente hacia las restricciones en la inteligencia artificial (IA) y la robótica en el contexto militar. El comentario de Putin revela una tendencia a posponer la regulación de estas tecnologías hasta que las amenazas se materialicen. Esta actitud genera incertidumbres críticas sobre la integración de la autonomía de la IA en el arsenal militar ruso, en contraposición a las políticas más cautelosas y éticas adoptadas por sus rivales, especialmente los Estados Unidos.

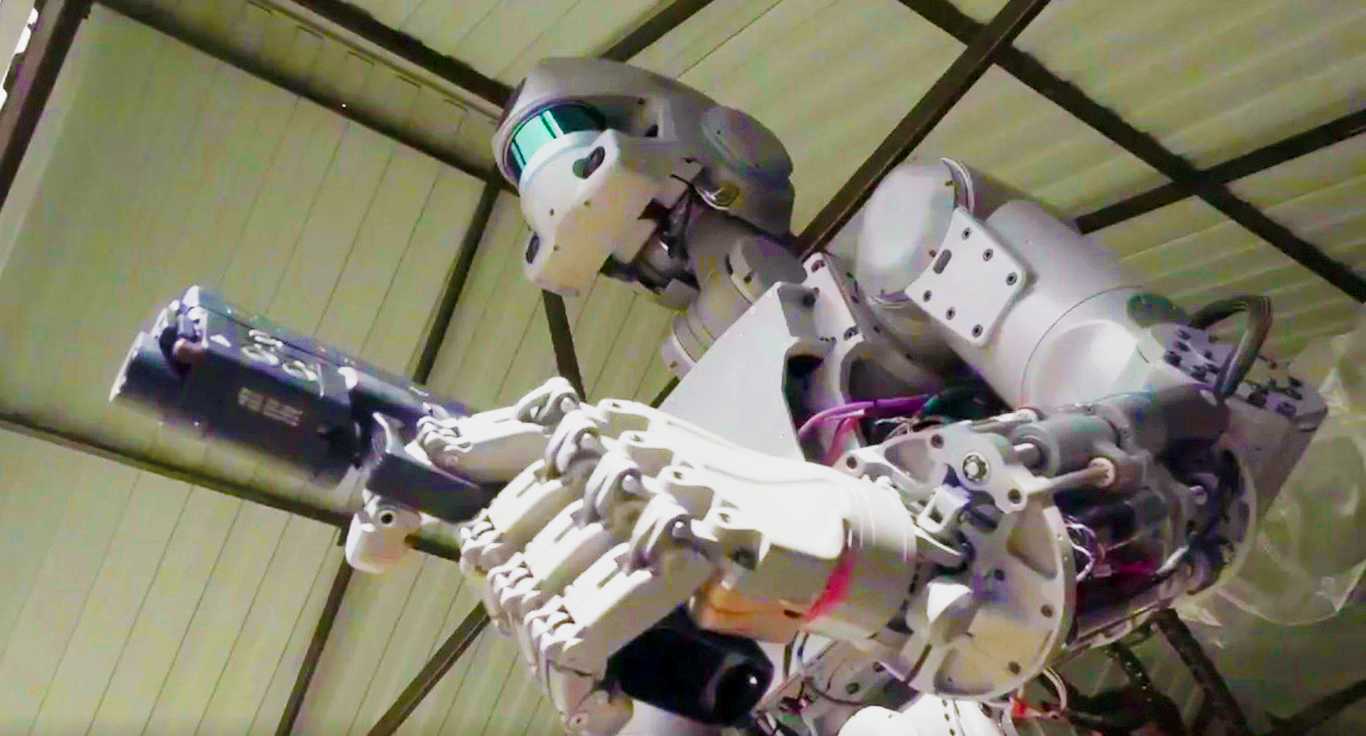

La IA militar puede variar desde automatizaciones básicas hasta sistemas de autoaprendizaje avanzados. Mientras el Pentágono ha adoptado un enfoque riguroso en cuanto a ética y operaciones de combate con IA, la reticencia de Rusia y China a seguir normativas estrictas en este ámbito plantea serias preocupaciones. Es notable que el Pentágono mantiene la doctrina del “hombre en el bucle” para armas autónomas, exigiendo intervención humana en decisiones de uso de fuerza letal. Sin embargo, el avance de la IA plantea interrogantes sobre su aplicación en medidas defensivas no letales y la disposición de Rusia y China a enfrentar ejércitos de robots armados con IA que operan de manera autónoma.

La falta de un consenso global sobre las restricciones en la IA militar subraya la importancia de entender la postura de Rusia para anticipar su rol en el cambiante panorama de la IA y la robótica militar.

Análisis de la integración de IA en el armamento militar ruso

Las ambiciones de Rusia en tecnología militar se reflejan en sus iniciativas en ingeniería mecánica, incluyendo la producción de tanques, robots, láseres y vehículos blindados. A pesar de su dependencia tradicional en la mano de obra física de los soldados, la IA representa un factor significativo en su estrategia militar. Durante una reunión del Ministerio de Defensa, Putin reconoció el interés creciente en la IA, pero sin consolidar un enfoque ético claro para su desarrollo y aplicación.

La evaluación de los riesgos asociados con el despliegue autónomo de la IA en el ámbito militar es crucial para un uso responsable. En este contexto, es notable que el ejército estadounidense ya emplea la IA para generar recomendaciones de armamento durante ataques, manteniendo restricciones de intervención humana (Human-in-the-loop). Esta práctica contrasta con el enfoque menos definido de Rusia en cuanto a las consideraciones éticas para las aplicaciones de IA en el ámbito militar.

Las modernas integraciones de IA en ingeniería militar enfatizan el uso metódico de la fuerza, recomendando armamento adecuado para operaciones específicas. Los riesgos de posponer la regulación hasta que surjan amenazas tangibles resaltan la necesidad de previsión ante el rápido avance de la IA.

Implicaciones éticas y estratégicas en la guerra autónoma

A pesar de las afirmaciones de “superioridad armamentística”, tanto Rusia como los Estados Unidos tienen la capacidad de simular la guerra. Sin embargo, la capacidad industrial se convierte en un factor crítico al evaluar el desarrollo tecnológico militar. Esto podría obstaculizar los avances rusos en tecnología de nueva generación para la guerra, mientras que las fuerzas militares estadounidenses cuentan con una robusta capacidad industrial para reconstruir fuerzas armadas durante conflictos prolongados.

Las evaluaciones éticas son fundamentales para mitigar las consecuencias imprevistas de la guerra autónoma. Contribuyen a la transparencia en el desarrollo y despliegue de armas autónomas y fomentan la confianza pública. La adopción de prácticas éticas abiertas fortalece la legitimidad de las tecnologías de guerra autónoma.

Además, estas evaluaciones aseguran el cumplimiento del derecho humanitario internacional, incluyendo los Convenios de Ginebra, y contribuyen a la estabilidad estratégica a largo plazo, evitando carreras armamentísticas desestabilizadoras en el campo del armamento autónomo.

Rusia ha expresado interés en la IA para tecnología militar, pero no hay confirmación de robots “Terminator”. Sin embargo, el país está avanzando en ingeniería mecánica, incluyendo tanques y robots.

Mientras EE. UU. insiste en la aprobación humana para fuerza letal, Rusia carece de normas claras. Las fuerzas estadounidenses usan restricciones Human-in-the-loop, mientras que Rusia debate ética.

Putin reconoce el interés en IA, pero su postura sobre evaluaciones éticas es ambigua. Rusia planea integrar IA en su arsenal, reflejado en iniciativas de ingeniería mecánica y tecnología militar.

La madurez de la IA presenta desafíos, como la evaluación de riesgos potenciales y la prevención de consecuencias imprevistas. La falta de regulaciones claras aumenta la incertidumbre en el desarrollo de armas autónomas.

Ambos países simulan la guerra, pero el ritmo industrial difiere. Rusia puede enfrentar desafíos en avances tecnológicos rápidos, mientras que EE. UU. cuenta con respaldo industrial para conflictos prolongados.